Hệ thống quản lý năng lượng tại gia AI tác nhân: Một khung mô hình ngôn ngữ lớn cho việc lập lịch phụ tải dân dụng

Agentic AI home energy management system: A large language model framework for residential load scheduling

| Tác giả |

Reda El Makroum Sebastian Zwickl-Bernhard Lukas Kranzl |

| Ngày đăng tải | 01/03/2026 |

| DOI | https://doi.org/10.1016/j.rineng.2026.109857 |

| Nguồn bài nghiên cứu | Science Direct |

| Từ khóa |

AI tác nhân Hệ thống quản lý năng lượng tại gia Mô hình ngôn ngữ lớn Đáp ứng nhu cầu Lập lịch phụ tải |

1 – GIỚI THIỆU

Quá trình chuyển đổi ngành điện đòi hỏi phải tăng cường đáng kể năng lực đáp ứng nhu cầu (demand response) từ khu vực dân dụng, tuy nhiên việc áp dụng các Hệ thống quản lý năng lượng tại gia (HEMS) vẫn còn hạn chế do các rào cản về tương tác với người dùng. Các mô hình ngôn ngữ lớn (LLM) mang lại tiềm năng to lớn để giải quyết những rào cản này thông qua khả năng tương tác bằng ngôn ngữ tự nhiên; tuy nhiên, các triển khai hiện nay chủ yếu sử dụng LLM như trình tạo quy tắc, trình tối ưu hóa hoặc trình trích xuất tham số hơn là các thực thể điều phối tự chủ cho việc lập lịch đa thiết bị. Nghiên cứu này giới thiệu một hệ thống HEMS AI tác nhân, nơi các LLM tự chủ điều phối việc lập lịch từ các yêu cầu ngôn ngữ tự nhiên của người dùng mà không yêu cầu đặc tả tham số kỹ thuật phức tạp. Theo Cơ quan Năng lượng Quốc tế (IEA), công suất đáp ứng nhu cầu toàn cầu phải đạt 500 GW vào năm 2030, gấp 10 lần so với mức của năm 2020, trong đó các tòa nhà và xe điện dân dụng đóng góp khoảng 60% tiềm năng này. Mặc dù HEMS đã chứng minh được hiệu quả kỹ thuật trong việc giảm chi phí điện năng, nhưng việc áp dụng rộng rãi vẫn bị cản trở bởi yêu cầu người dùng phải dịch các sở thích hàng ngày thành các tham số kỹ thuật chính xác cho các thuật toán tối ưu hóa, một quy trình tốn thời gian và gây nản lòng cho những người dùng không chuyên. Bài nghiên cứu này đề xuất giải quyết rào cản đó thông qua một giao diện đàm thoại trực quan, không chỉ thực hiện lập lịch mà còn có khả năng giải thích các quyết định, xác định sự thiếu hiệu quả trong tiêu thụ và đưa ra các khuyến nghị điều chỉnh hành vi.

2 – MÔ TẢ HỆ THỐNG

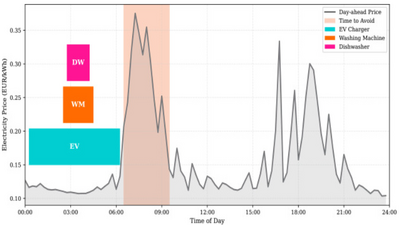

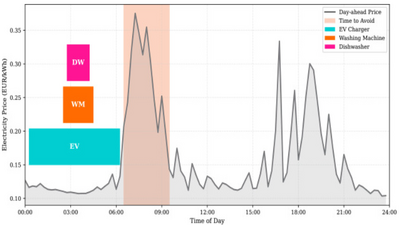

Hệ thống được thiết kế dựa trên một kiến trúc AI phân cấp bao gồm một tác nhân điều phối (orchestrator) trung tâm và ba tác nhân chuyên gia (specialist agents), tất cả đều được vận hành bởi cùng một mô hình ngôn ngữ lớn để đảm bảo khả năng phối hợp tự chủ. Tác nhân điều phối đóng vai trò là thực thể điều hành cốt lõi, chịu trách nhiệm phân tích các yêu cầu của người dùng, truy xuất các nguồn dữ liệu chung như giá điện theo thời gian thực từ API của ENTSO-E và các sự kiện lịch từ Google Calendar, sau đó ủy quyền các nhiệm vụ lập lịch cụ thể cho các tác nhân chuyên gia. Ba tác nhân chuyên gia được triển khai bao gồm: tác nhân máy giặt (WM), tác nhân máy rửa bát (DW) và tác nhân sạc xe điện (EV). Tác nhân máy giặt và máy rửa bát thực hiện tối ưu hóa chu kỳ thông qua phân tích cửa sổ trượt trên 96 khoảng thời gian hàng ngày (mỗi khoảng 15 phút) để tìm ra thời điểm có chi phí thấp nhất mà vẫn đáp ứng các ràng buộc về thời hạn của người dùng. Tác nhân sạc xe điện có khả năng nhận thức thời hạn dựa trên lịch trình từ Google Calendar, cho phép hệ thống tự suy luận thời hạn sạc mà không cần người dùng chỉ dẫn rõ ràng. Thiết kế phân cấp này cho phép hệ thống mở rộng quy mô tính toán một cách linh hoạt, trong đó độ phức tạp của hệ thống tăng tuyến tính theo số lượng thiết bị thay vì tăng theo tổ hợp. Toàn bộ hệ thống hoạt động mà không cần các ví dụ trình diễn (zero-shot learning), dựa hoàn toàn vào các mô tả công cụ và hướng dẫn nhiệm vụ trong lời nhắc (prompt) để thực hiện các quyết định lập lịch tối ưu.

3 – PHƯƠNG PHÁP NGHIÊN CỨU

Phương pháp nghiên cứu sử dụng mô hình ReAct (Reason + Act) để điều phối các nhiệm vụ lập lịch thông qua các chu kỳ ra quyết định lặp đi lặp lại giữa lý luận và hành động. Tác nhân điều phối xen kẽ giữa giai đoạn lý luận để phân tích trạng thái hiện tại và giai đoạn hành động để kích hoạt một trong sáu công cụ có sẵn, bao gồm lấy giá điện, truy vấn ràng buộc lịch, tính toán tổng chi phí cửa sổ, gọi tác nhân thiết bị, thực thi lập lịch và kết thúc quy trình. Nghiên cứu tiến hành đánh giá trên ba mô hình ngôn ngữ lớn nguồn mở khác nhau là Llama-3.3-70B, Qwen-3-32B và GPT-OSS-120B, tất cả đều được truy cập thông qua API của Cerebras với tốc độ suy luận lên tới 2500 mã báo (token) mỗi giây. Quá trình đánh giá được thực hiện qua ba chiều: tính tối ưu của việc lập lịch, khả năng điều phối đa thiết bị và xử lý các truy vấn phân tích trực tiếp. Các lịch trình do AI tạo ra được so sánh với các giải pháp tối ưu “đất thực” (ground truth) được tính toán thông qua lập trình tuyến tính nguyên hỗn hợp (MILP) để xác thực hiệu suất. Thử nghiệm bao gồm 75 lần chạy thực nghiệm vào tháng 10 năm 2025, sử dụng tích hợp API thời gian thực cho giá điện và các ràng buộc lịch, với nhiệt độ mô hình được đặt ở mức 0.0 để đảm bảo tính xác định của kết quả. Đối với các truy vấn phân tích, nghiên cứu áp dụng kỹ thuật kỹ thuật lời nhắc (prompt engineering) lũy tiến qua ba giai đoạn: Cơ sở (không hướng dẫn), Hướng dẫn tối thiểu và Quy trình công việc rõ ràng để xác định mức độ chỉ dẫn cần thiết cho mô hình.

4 – KẾT QUẢ NGHIÊN CỨU

Kết quả thực nghiệm cho thấy sự khác biệt đáng kể giữa các mô hình trong khả năng điều phối đa thiết bị mặc dù tất cả đều đạt hiệu suất tối ưu 100% trong kịch bản thiết bị đơn lẻ. Mô hình Llama-3.3-70B thể hiện khả năng vượt trội khi duy trì tỷ lệ thành công 100% trong việc điều phối đồng thời cả ba thiết bị (máy giặt, máy rửa bát và bộ sạc xe điện) theo đúng các mốc thời gian tối ưu chi phí của MILP. Ngược lại, Qwen-3-32B và GPT-OSS-120B gặp thất bại nghiêm trọng trong việc điều phối đa thiết bị; Qwen chỉ đạt tỷ lệ thành công 20% và thường xuyên bỏ qua việc tích hợp xe điện, trong khi GPT-OSS không thể lập lịch cho máy rửa bát hoặc xe điện dù đã truy xuất được các ràng buộc liên quan. Phân tích tiêu thụ tài nguyên cho thấy việc điều phối đa thiết bị làm tăng lượng token tiêu thụ lên gấp 2,5 lần so với thiết bị đơn lẻ, phản ánh các chu kỳ ủy quyền bổ sung cần thiết. Trong kịch bản truy vấn phân tích, không có mô hình nào tự nhận diện được nhu cầu sử dụng công cụ tính toán ở giai đoạn Cơ sở; tuy nhiên, khi được cung cấp Quy trình công việc rõ ràng, cả ba mô hình đều đạt độ chính xác 100%. Thời gian thực thi của Llama-3.3-70B cho một quy trình lập lịch đa thiết bị hoàn chỉnh vẫn duy trì ở mức thực tế là dưới 15 giây, chứng minh rằng AI tác nhân có thể đáp ứng tốt các yêu cầu về trải nghiệm người dùng trong môi trường gia đình. Nghiên cứu cũng chỉ ra rằng hiệu quả sử dụng token có thể được cải thiện tới 40% thông qua các chiến lược kỹ thuật như sử dụng tác nhân chuyên gia đơn lượt và bộ nhớ đệm dữ liệu tham chiếu.